GPT AI 数据安全

数据安全是 GPT 应用的价值前提,企业需通过数据隔离、权限控制、审计追溯等手段,构建“输入-处理-输出”全流程防护,在释放 AI 效能的同时守住安全边界,确保技术创新与风险控制的动态平衡。

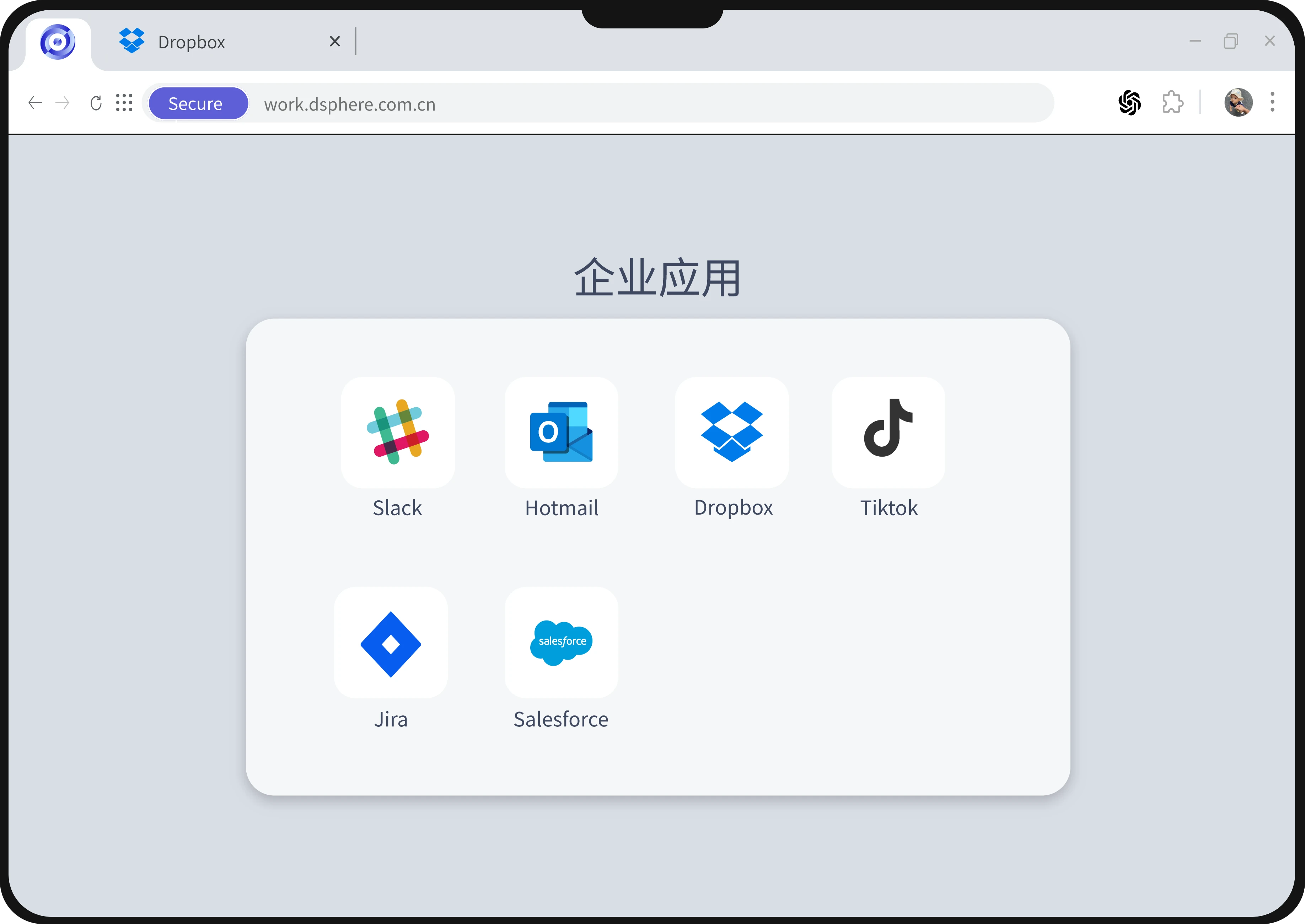

企业在使用 GPT 工具时,面临的数据泄露风险

企业员工在使用基于 GPT 的工具时面临的数据泄露风险是显著的。根据一份报告,大约 25% 的员工可能会将敏感数据上传到这类 AI 工具中,这包括公司的商业计划、客户信息、产品设计等重要机密信息。这种行为存在数据泄露的风险,因为像 ChatGPT 这样的 AI 工具并不具备与防病毒软件相同级别的安全功能,无法对上传的数据进行有效的安全检查或保护。

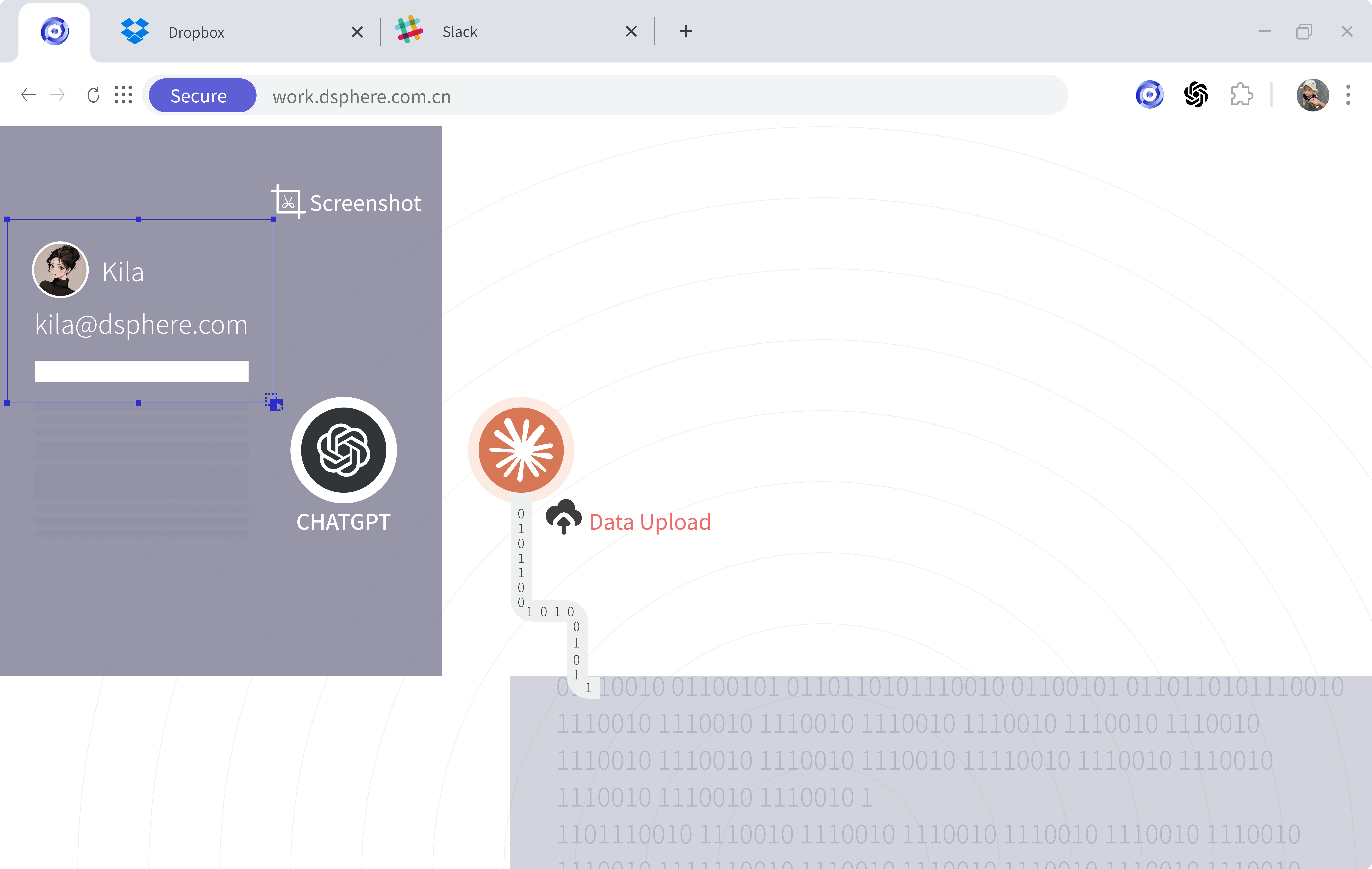

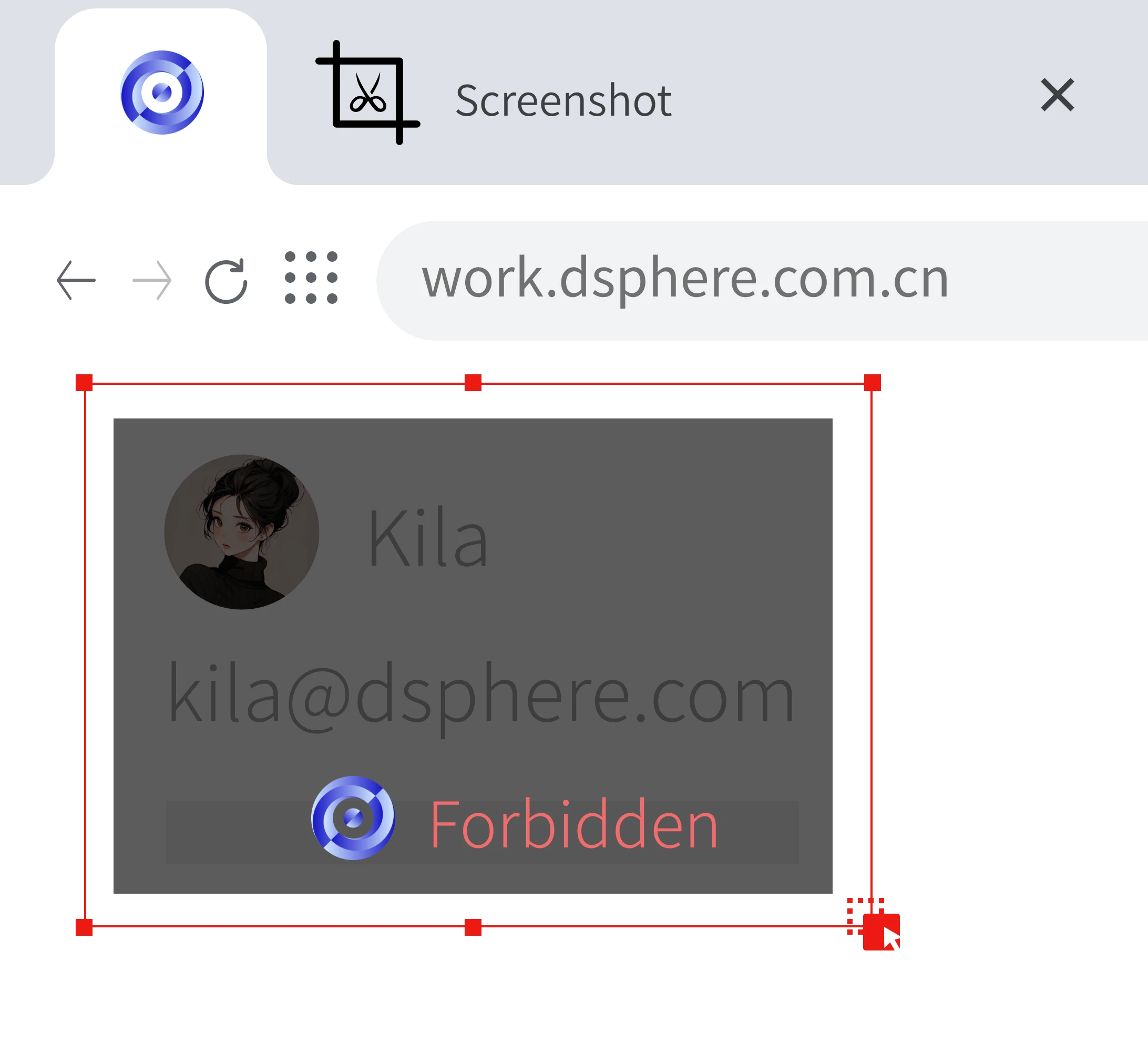

GPT 截屏防护

禁止截屏

禁止 GPT 工具针对敏感的业务系统,或者敏感的系统页面进行自动截屏操作。

管控系统辅助权限

防止桌面自动化 AI 通过系统“辅助功能”识别页面元素和文字,从而造成数据流失。

产品优势

使用轻量化,交付轻量化,运维轻量化

云办公优选

云原生,移动互联网时代,企业基于云的,新办公形态数据安全解决方案

设备无关

工作环境与设备解耦,远离终端安全威胁,支持自带设备办公(BYOD)

10分钟部署

支持本地部署,容器化部署形式,10 分钟即可完成部署和交付

零代码接入

开箱即用,企业现有网络、应用和零代码改造,即可实现安全接入

部分客户

是时候重构企业数据安全了

如果你的企业,还停留在数十年前的,终端文档外发管控阶段;如果企业的数据安全,还再以侵犯员工隐私为代价。那么是时候做出改变了!